La navigation autonome est la capacité d’un robot à se déplacer dans un environnement sans contrôle externe tout en percevant, comprenant et cartographiant ses environs. Cette tâche, autrefois limitée aux laboratoires de recherche avancée, est devenue de plus en plus accessible aux amateurs grâce à des composants à faible coût et à des logiciels open-source. Un bon exemple est le RPLIDAR A1, qui offre un balayage à 360° avec jusqu’à 8 000 échantillons par seconde pour moins de 150 $, ce qui était auparavant impensable pour les amateurs. De même, des microcontrôleurs abordables tels que le Raspberry Pi 4 (à partir de 35 $) ou l’ESP32 (moins de 10 $) fournissent une puissance de traitement suffisante pour des tâches de localisation en temps réel. Au cœur de la navigation autonome se trouve le SLAM—Simultaneous Localization and Mapping—une méthode qui permet aux robots de construire une carte d’un environnement inconnu tout en suivant leur propre position à l’intérieur de celui-ci. Le SLAM intègre des données provenant de capteurs tels que des modules ultrasoniques (avec des plages typiques de 2 à 400 cm), des unités IMU à faible coût ou des unités LIDAR abordables pour générer une carte cohérente. Avec des plateformes comme ROS (Robot Operating System) et des bibliothèques SLAM légères telles que TinySLAM ou GMapping, même les débutants peuvent commencer à construire des robots qui comprennent leur monde en 2D ou en 3D. En conséquence, la navigation autonome n’est plus réservée aux institutions de recherche—c’est une véritable possibilité pour les makers passionnés.

Qu’est-ce que le SLAM ?

SLAM (Simultaneous Localization and Mapping) est une méthode informatique qui permet à un robot de créer une carte d’un environnement inconnu tout en déterminant simultanément sa position dans celui-ci. Ce double défi est fondamental en robotique et est utilisé dans des systèmes tels que le robot aspirateur iRobot Roomba, qui cartographie les pièces pour un nettoyage efficace, ou le rover Perseverance de la NASA, qui utilise le SLAM visuel pour naviguer sur Mars. Le SLAM combine les données des capteurs, tels que le LIDAR, les caméras ou les IMU, avec des algorithmes comme les filtres de Kalman étendus ou les filtres particules pour mettre à jour à la fois la carte et la position du robot en temps réel. Par exemple, le Cartographe de Google ou GMapping dans ROS permet même aux amateurs d’implémenter un SLAM 2D avec des capteurs abordables comme le RPLIDAR A1 et un Raspberry Pi.

Pourquoi le SLAM est-il crucial ?

- Il permet aux robots d’explorer des espaces inconnus.

- Il améliore l’autonomie sans GPS ni cartes prédéfinies.

- Il ouvre la porte à des applications avancées telles que l’évitement d’obstacles et la planification de trajectoires.

Composants essentiels du SLAM

Pour implémenter un SLAM de base, un robot a généralement besoin de :

- Capteurs : Pour percevoir l’environnement.

- Odométrie : Pour estimer le mouvement (via les roues ou les capteurs inertiels).

- Unité de traitement : Arduino, Raspberry Pi ou ESP32 pour le calcul.

- Algorithme SLAM : Pour calculer la carte et la position.

Capteurs à bas prix pour les débutants

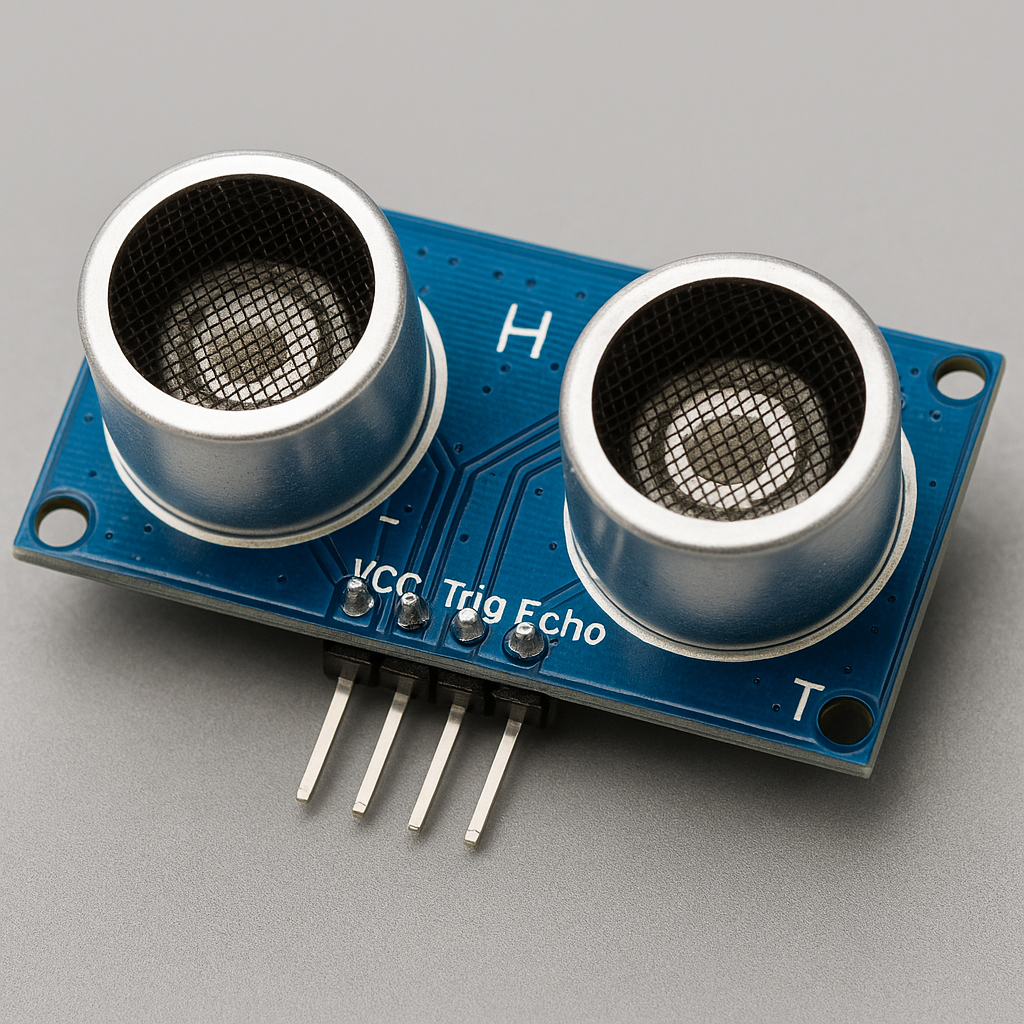

1. Capteurs ultrasoniques (par exemple, HC-SR04)

Les capteurs ultrasoniques mesurent la distance en émettant des ondes sonores et en calculant le temps nécessaire pour que l’écho revienne. Typiquement, ces capteurs, comme le HC-SR04, offrent des plages de 2 cm à 4 mètres, avec une précision de ±3 mm. Ils sont bon marché, coûtant entre 1 et 5 $, et sont faciles à intégrer avec des microcontrôleurs comme Arduino. Malgré leur faible coût, les capteurs ultrasoniques ont un champ de vision étroit (généralement entre 15 et 30 degrés) et peuvent souffrir de données bruyantes dues aux réflexions de surface ou aux objets irréguliers. Cela peut entraîner des erreurs dans les lectures de distance, surtout dans des environnements complexes. Cependant, ils sont encore largement utilisés pour la détection d’obstacles de base et les tâches de cartographie simples.

Capteurs ultrasoniques

Capteurs ultrasoniques

2. Capteurs infrarouges

Les capteurs de proximité infrarouges (IR) sont couramment utilisés pour la détection d’obstacles à courte portée, généralement efficaces dans une plage de 1 à 80 cm, selon la puissance du capteur et l’environnement. Ces capteurs, tels que le Sharp GP2Y0A21YK0F, offrent une résolution de 1 cm et sont idéaux pour des applications comme l’évitement de collisions dans les robots. Bien qu’ils ne soient pas adaptés pour une cartographie à grande échelle en raison de leur portée limitée et de leur sensibilité aux conditions environnementales (par exemple, les interférences lumineuses), ils sont très efficaces dans des espaces contrôlés. Les capteurs infrarouges sont abordables, avec des prix variant de 3 à 10 $, et sont couramment utilisés dans des robots comme les Roombas ou les bras robotiques pour la navigation de proximité et la détection d’obstacles.

3. LIDAR abordable (par exemple, RPLIDAR A1/A2)

Le LIDAR (Light Detection and Ranging) fournit des mesures de distance à 360 degrés, offrant une grande précision et précision, généralement avec une portée allant jusqu’à 12 mètres. Le RPLIDAR A1, un capteur LIDAR d’entrée de gamme populaire, est idéal pour les débutants et est compatible avec des plateformes comme Raspberry Pi ou ROS. Il offre une numérisation à 360° à une fréquence de 5,5 Hz et une résolution angulaire de 0,36°, permettant une cartographie détaillée des environnements. Bien qu’il soit plus cher que les capteurs ultrasoniques, qui peuvent coûter aussi peu que 1 à 5 $, le RPLIDAR A1 reste abordable pour les passionnés, avec un prix variant entre 100 et 150 $. Le LIDAR est particulièrement utile pour créer des cartes 2D ou 3D précises et est utilisé dans des véhicules autonomes, des drones et des applications robotiques où une prise de conscience spatiale élevée est essentielle. Sa polyvalence et sa précision en font un outil précieux pour les amateurs souhaitant créer des systèmes de navigation et de cartographie plus avancés.

Comment fonctionne le SLAM (simplifié)

1. Perception de l’environnement

Le robot utilise ses capteurs pour recueillir des points de données (par exemple, des distances aux murs). Ceux-ci sont utilisés pour créer une structure de carte de base.

2. Estimation de la position

Le robot estime son mouvement en utilisant des codeurs de roues ou un IMU (unité de mesure inertielle). Cette estimation aide à déterminer où les nouvelles données du capteur doivent être placées sur la carte.

3. Mise à jour de la carte

En utilisant des algorithmes tels que le filtre de Kalman étendu (EKF) ou le filtre particulaire, le robot affine sa position et met à jour le modèle de l’environnement.

4. Fermeture de boucle

Lorsque le robot revisite un emplacement connu, il corrige les erreurs de carte et de position — une étape cruciale pour garantir une précision à long terme.

Bibliothèques et outils SLAM populaires

- GMapping : SLAM 2D classique, idéal pour les débutants utilisant ROS.

- Cartographer (par Google) : Plus avancé mais robuste pour le SLAM basé sur le LIDAR.

- RTAB-Map : Bon pour la cartographie 3D et le SLAM visuel.

- TinySLAM : Léger et convivial pour les débutants.

Configuration matérielle conviviale pour les débutants

Microcontrôleur : Raspberry Pi 4

Capteurs : RPLIDAR A1 + IMU (MPU6050)

Contrôle moteur : L298N ou autre contrôleur de moteur similaire

Alimentation : Pack de batteries Li-ion 18650 (7,4V avec régulation)

Exemple d’implémentation SLAM de base (avec ROS)

Voici un exemple de configuration pour faire fonctionner le SLAM avec un LIDAR et ROS sur un Raspberry Pi :

# Installer ROS sur Raspberry Pi (par exemple, ROS Noetic)

sudo apt install ros-noetic-slam-gmapping

# Lancer le robot avec RPLIDAR

roslaunch rplidar_ros view_rplidar.launch

# Exécuter le SLAM

rosrun gmapping slam_gmapping scan:=/scan

Défis courants pour les débutants

- Bruit des capteurs : Utilisez des filtres (par exemple, Kalman ou moyennage) pour nettoyer les données.

- Glissement des roues ou erreurs des codeurs : Combinez avec un IMU ou un retour visuel.

- Manque de puissance de traitement : Déchargez le calcul vers un PC si le Pi/Arduino lutte.

Conseils pour réussir

- Commencez dans des environnements petits et contrôlés (comme une pièce).

- Visualisez les données en temps réel avec RViz ou des outils similaires.

- Enregistrez les données des capteurs pour une analyse et un débogage hors ligne.

- Testez les composants individuels avant de lancer la boucle SLAM complète.

Conclusion

Le SLAM peut sembler être de la robotique avancée, mais avec les outils open-source d’aujourd’hui et des capteurs abordables, il est entièrement accessible pour les amateurs motivés. Que vous construisiez un robot pour l’automatisation à domicile, l’exploration ou l’éducation, maîtriser la navigation autonome est une étape gratifiante et valorisante.

Commencez petit, expérimentez souvent, et n’hésitez pas à plonger dans la communauté open-source de la robotique pour obtenir du soutien et de l’inspiration !